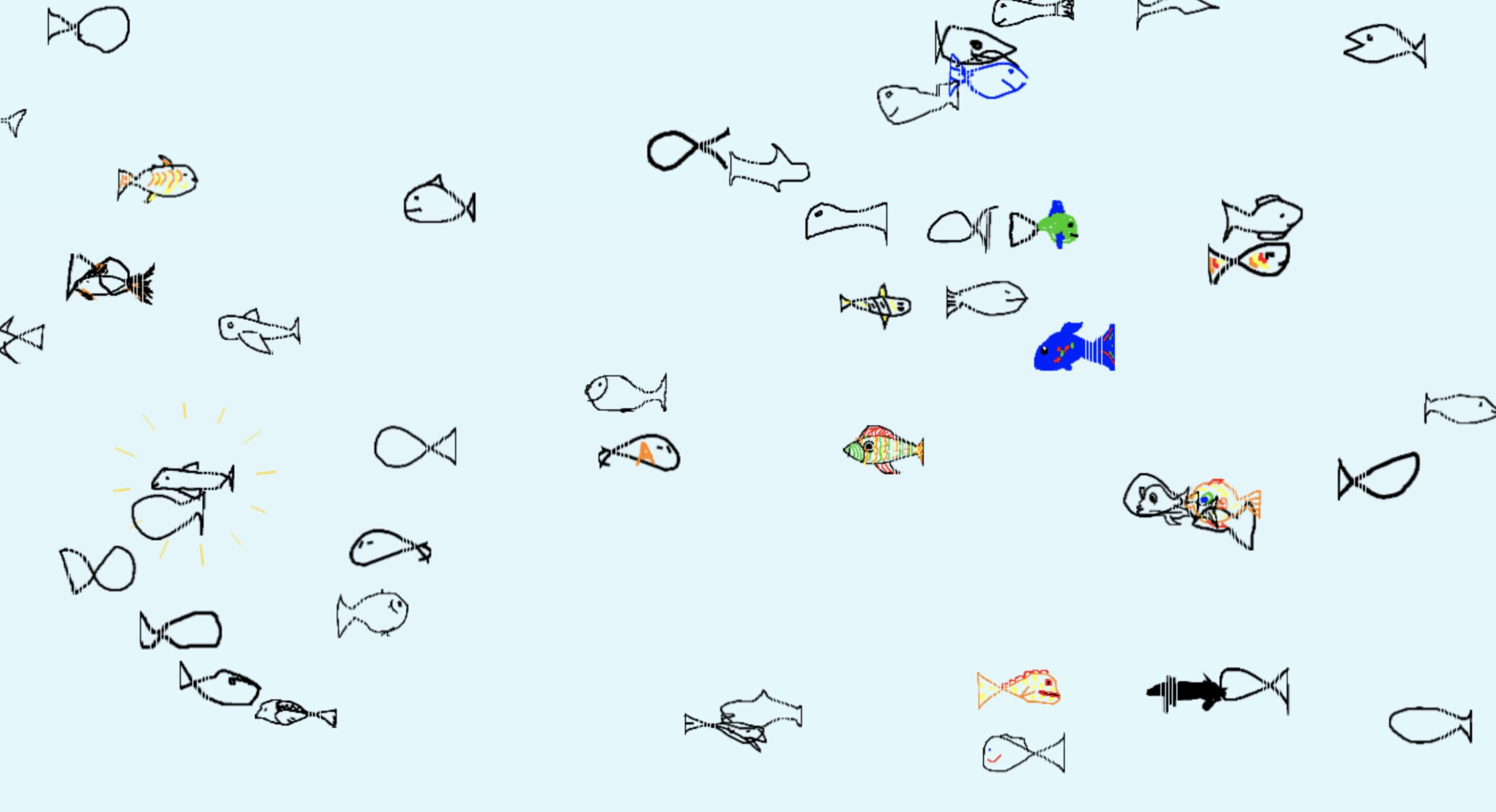

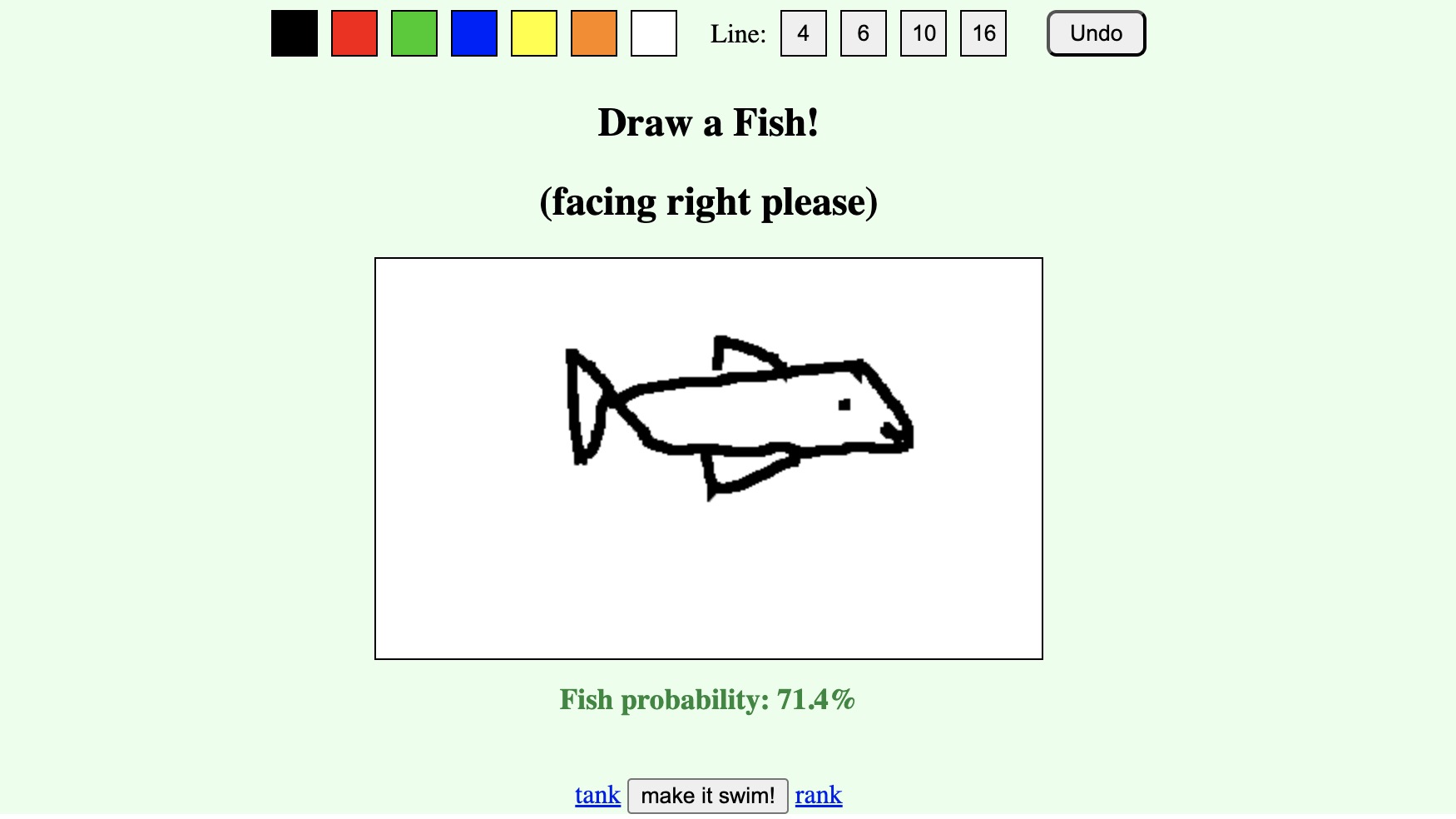

Falls ihr gerade nichts anderes zu tun habt, könnt ihr bei Draw a Fish einfach mal eben einen Fisch ins Internet malen und ihn dort dann in einem virtuellen Aquarium schwimmen lassen. Mit Fischen von anderen, die gerade nichts anderes zu tun haben. Ich habe gerade tatsächlich viele andere Sachen zu tun und trotzdem gerade einen Fisch ins Internet gemalt. Natürlich! Fish probability: 71,4%.

Bestes Prokrastinationsmaterial.

(via BoingBoing)